在人工智能应用软件开发日益普及的今天,其带来的认识论不公正问题逐渐浮出水面,成为社会关注的焦点。认识论不公正,指的是由于偏见或结构性不平等,某些群体或个体在知识获取、表达和传播中被边缘化,导致其观点和经验被忽视或贬低。人工智能系统在开发和应用过程中,如果未能充分考虑到这一点,可能加剧社会不公,并对用户产生深远影响。

人工智能应用软件开发中的认识论不公正主要表现为数据偏见和算法歧视。开发者通常依赖于历史数据进行模型训练,而这些数据往往反映了社会中的既有不平等。例如,在招聘类应用中,如果训练数据主要来自男性主导的行业,算法可能偏向推荐男性候选人,从而忽视女性的能力和潜力。类似地,在医疗健康应用中,数据集的单一性可能导致对少数族裔或特定性别群体的诊断误差。这种偏见不仅强化了现有社会不公,还可能限制用户获取公平的知识资源,从而加剧认识论不公正。

开发团队的同质化是导致认识论不公正的关键因素。如果开发人员主要来自特定背景(如技术精英群体),他们可能缺乏对多元文化和边缘群体需求的理解。这会导致应用设计时忽视不同用户的认识方式和知识表达。例如,在教育应用中,如果只基于主流语言和文化设计交互界面,可能无法有效服务于语言少数群体或文化背景不同的用户,进一步加深知识鸿沟。

人工智能系统的决策过程往往缺乏透明度,这使得认识论不公正问题更难被发现和纠正。用户可能无法理解算法如何做出推荐或判断,从而无法质疑其背后的偏见。例如,在社交媒体应用中,内容推荐算法可能无意中强化信息茧房,导致用户只接触到特定观点,而忽视多元化声音,这间接剥夺了用户获取全面知识的权利。

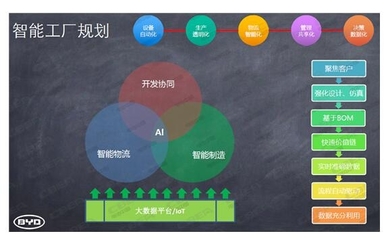

为了应对这些挑战,开发者在人工智能应用软件开发中应采取积极措施。引入多元化的开发团队,包括不同性别、种族、文化背景和专业领域的成员,以确保在设计和测试阶段充分考虑多样化的用户需求。实施数据审核和偏见检测机制,定期评估训练数据的代表性,并采用公平算法来减少歧视。提高系统的透明度和可解释性,让用户能够理解算法的决策过程,并提供反馈渠道。加强伦理培训和监管,确保开发过程遵循公正原则,促进包容性创新。

人工智能应用软件开发在带来便利的也潜藏着认识论不公正的风险。通过共同努力,我们可以构建更公平、透明和包容的人工智能系统,帮助弥合知识鸿沟,推动社会进步。